Navigation menu

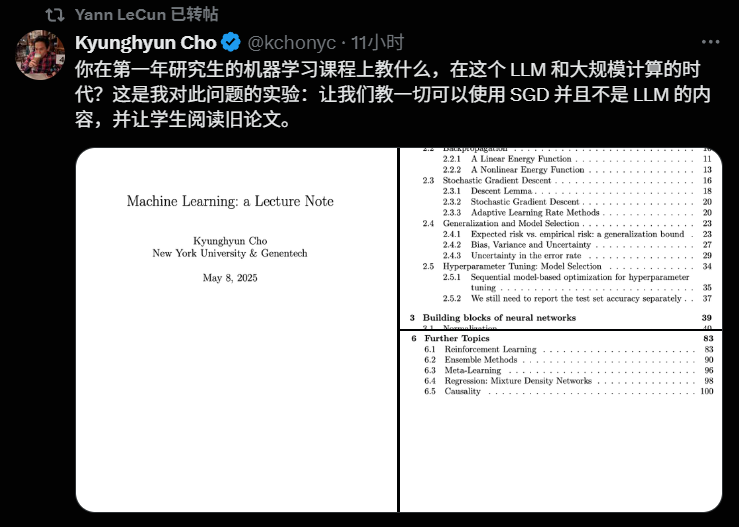

Machine Heart Report:+0最近的编辑,首席AI科学家和图灵奖得主Lecun已退休了他的同事Kyununyun Cho的职位:这是关于2025年研究年度研究年度研究年度研究年度教授的教学大纲和讲义。地址ng讲义:https://arxiv.org/abs/2505.03861 pagtuturo大纲:https://docs.google.com/document/document/d/1ongr25im5bj458j458j8j8z4ocntfg87kj5ihgwojujujujujuju1ddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddd64 pag -aaral ng机器na natutunan ang算法可能会随机梯度(作为核心,并故意避免语言模型(LLM)(LLM)。同时,鼓励学生在领域深处研究经典的文书工作,并追溯到机器学习的理论发展背景。但是,在此时,所有人都在付出了其他赛车,但要比其他人进行了启示。毕业于主要宇宙ITIE通常以基本理论和经典模型为中心。例如,斯坦福CS229是对主机的经典研究。 With the introduction of the winter course of 2025, the course systematically teaches basic models and techniques including linear regression, logistic regression, SVM, neural network, clustering, dimensionality reduction, EM algorithm, etc. The 6.790 MIT course is the study course of the main machine at its postgraduate stage, formerly known as 6.867 and that is updated at 6.7900.该课程强调了从概率建模和推理的角度研究机器的方法的深刻理解,适合那些想要建立理论与技能之间稳定联系的人。 Tsinghua电子部门的课程还建立了基本的理论课程,例如“机器研究”和“统计推论理论和方法”。 LLM的最新内容主要出现在特殊的选修课程中CH作为斯坦福大学CS25:Transformers United,专注于LLM的研究课程和变形金刚建筑。有关详细信息,请参阅“ Openai和Google等开放一线大型模型科学家”。 Stanford CS25将于春季推出! 》。可以看出,教育社区通常认为基本教学有助于学生的长期发展。 Chit在编写讲义时提到萨顿的“痛苦课”,强调普遍的可扩展技术(例如NG SGD作为主要的)比特定的体系结构更为重要。他故意删除复杂的系统(例如LLM),并专注于历史上的成熟幻想和数学直觉,认为“一个学期不足以渗透所有学科”,因此他只能将坚实的基础放在首位。此外,Cho在他的博客中指出,在2010年至2015年之间,深入研究尚不流行,许多神经网络只是许多ML课程。现在,通过强调经典方法,阅读ClassiC论文可以让学生了解知识的资源和发展,并培养批判性思维能力。通常,教学的主要重点使学生能够掌握优化算法背面的数学原则和方法,而不是“盲目应用”最新模型。理论与培训相比,但我们无法避免的一个问题是:大学培训机制(尤其是研究生/医生教育)强调了科学研究的基础,原理和技能,而实际的工作环境通常需要快速响应,工程实施和相关的技能,尤其是在行业中。在某些情况下,对“应理解的深度原则”的盲目压力似乎很漂亮,“为什么不吃切碎的肉”。 “如何在不引起注意Q/K/V向量的情况下修复模型?”事实可能是:“我只想知道一种好的调整方法,并与美洲驼一起编写客户服务机器人。”许多Muniversity正在积极探索解决方案。为了建立科学研究和工程能力之间的连通性,许多学校已经开设了“桥接”课程或实践项目。例如,根据CS229等理论课程,斯坦福大学专门建立了CS329S“机器学习系统设计”的实用课程。本课程的重点是如何开发实际部署,稳定和测量的机械研究系统,包括数据处理,具有获取,模型启动和监视。 CMU的博士生应参加10-718课程“机器学习实践”。在本课程中,学生将需要完成学期项目,以生成和部署完整的机器研究系统。清楚地说,P The课程将描述学生将通过研究项目来解决实际情况下的数据问题,并掌握从清理原始数据到最终发布的完整过程技能模型。国内大学也开始关注实践教学。 Tsinghua大学电子系与企业合作,提供了许多实用课程,例如“大数据技术的应用和实践”,“高级机器学习”和“智能制造”等,这些课程介绍了教学过程中的行业和教学技能的实际情况。为什么高校仍然沉迷于“缓慢的工作”?反对当今的后期技术发展,许多大学仍在强调“为坚实的基础和深刻的理解,这不仅仅是“统一”。真正的技术能力不仅在于“学习如何使用工具”或“运行模型的能力”,还在于了解方法背后的原理以及在面对新问题和新技术时团结,判断和创造的能力。在基本经验中,他强调“可靠,及时更新basic knowledge is the key to being a highly productive engineer in the study of the article." Cnn up to transformer up to llm and mUsLimodal system, each step can interfere with existing engineering paradigm. In order to adapt to these changes, we cannot pursue hot topics, but we need to deeply understand the underlying theories such as optimization, generalization, and study of representation. Simply by understanding "why the design is like this" and "what are the assumptions背后“我们可以避免面对新技术时避免混乱。此外,深层的基础是科学研究和创新技术的起点。科学研究不仅是关于组织参数或制作论文,而且还涉及增加问题,建立假设和设计新方法,这是与良好的数学工具相距甚远的培训。也是思考和批判性思维能力的摘要。深度学习和图灵奖得主的获胜者杰弗里·欣顿(Geoffrey Hinton)在接受麻省理工学院技术评论的采访中被教授,这是对重大算法的长期持久性和深入研究,这些算法在深入研究中已经取得了成功。 “我们花了数十年的时间来抛光神经网络的基本原理,直到2010年我们才真正爆发了应用程序。对基础知识的积累和理解是AI领域每个主要发展的基础。”当然,这种教育道路并不忽略这种做法,而是强调真正的实践权力应该基于理解。您不应该知道如何使用工具,但是您还应该了解来和出口,适当的界限和改进的方向。因此,“找到工作”和“基础”不是许多选择中的任何一种,而是在时间大小的情况下进行权衡。在短期,工具技能可以导致直接匹配的工作;但是从长远来看,基本功能是转化为技术周期并继续增长的“护城河”。今天的课程讲义让我们看一下这100页的PDF课程讲义,该课程提供了对机器研究的全面介绍,该课程涵盖了基本概念和现代技术,感兴趣的读者可以阅读原始文本。每一章的结构和内容摘要如下:第1章:能量的人力资源是对能源运行的概念作为一项机器研究的概念。说明如何固定机器研究中的不同范式(管理研究,不支持研究,分类,集群等),以最大程度地减少能量功能。讨论潜在变量和正则化在确定和研究能量功能方面的作用。第2章:基本机器研究分类思想分类的主要分类算法,包括NG感知,边际损失,软磁性和横向渗透损失。解释分类器培训中的反向传播,重点是线性和非线性能量功能。讨论了研究率的随机梯度下降(SGD)和自适应方法。选择概括和模型是Skillgkot,包括偏见变化权衡和调整超参数调整。第3章:神经网络的主要构建块探索了神经网络体系结构上常用的构件。讨论了归一化方法(分批归一化,层归一化)。引入了卷积的块,圆形块和注意机制。引入了衰减和不变性的概念,例如神经网络上的置换。第4章:研究可能性和非监视研究的机器解释了如何从可能性中解释能量的功能。涵盖了差异不同的识别和高斯混合模型。连续的VA讨论了可误的模型和差异自动编码器(VAE)。引入了抽样及其差异的重要性。 Arkata 5:Waladired的生成模型探索了未指定的生成模型,重点是强制Boltzmann机器(RBMS)和专家产品(POE)。讨论Markov链蒙特卡洛(MCMC)方法,以从RBMS进行抽样。引入基于能源网络的基于网络的对抗网络(EBGANS)。涵盖自回归模型。第6章:其他主题提供了机器研究中许多高级主题的一般性决定。已经讨论了有关加强和多步加固研究的分步研究。探索了集成方法(包装包装的方法,提升方法)和贝叶斯机器研究。元学习简介。探索混合密度网络并引起关系。最后,让我们看一下Cho提到的经典论文,其中一部分是 - Xcerpt。 “简单统计梯度 - 遵循Algori连接主义者强化学习的THM“ - 朗德·J·威廉姆斯的论文地址:https://link.springer.com/article/10.1007/bf00992696本文提出了一种基于刺激方法的增强算法,一种基于刺激方法的方法,一种用于培训连接模型(例如神经网络)的较重要的方法(例如,现代的基础)。 Backprop” - Yann Lecun,Leon Botsou,Genevieve B. Orr,Klaus-RobertMüller(关注第4节)论文:https://link.springer.com/chapter/10.1007/978-978-3-3-642-642-642-35289-8_3逐步培训4次培训4个实用方法。最小化不同的差异-irs” -Geoffrey Hinton纸张地址:https://www.cs.toronto.edu/~hinton/~hinton/Absps/nccd.pdf建议培训有多样化的差异-cd)算法,以迫使Boltzmann Machine(rbm)neverction of Bots Boltzmann Machine(rbm)的基础,工作(DBN)。 - 贝叶斯方法结合了神经网络和概率建模,这成为发展模型领域的里程碑。少数算法。 MAML在研究几次射击领域是开创性的。有关更多详细信息,请参阅原始讲座和教学大纲笔记。

Machine Heart Report:+0最近的编辑,首席AI科学家和图灵奖得主Lecun已退休了他的同事Kyununyun Cho的职位:这是关于2025年研究年度研究年度研究年度研究年度教授的教学大纲和讲义。地址ng讲义:https://arxiv.org/abs/2505.03861 pagtuturo大纲:https://docs.google.com/document/document/d/1ongr25im5bj458j458j8j8z4ocntfg87kj5ihgwojujujujujuju1ddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddddd64 pag -aaral ng机器na natutunan ang算法可能会随机梯度(作为核心,并故意避免语言模型(LLM)(LLM)。同时,鼓励学生在领域深处研究经典的文书工作,并追溯到机器学习的理论发展背景。但是,在此时,所有人都在付出了其他赛车,但要比其他人进行了启示。毕业于主要宇宙ITIE通常以基本理论和经典模型为中心。例如,斯坦福CS229是对主机的经典研究。 With the introduction of the winter course of 2025, the course systematically teaches basic models and techniques including linear regression, logistic regression, SVM, neural network, clustering, dimensionality reduction, EM algorithm, etc. The 6.790 MIT course is the study course of the main machine at its postgraduate stage, formerly known as 6.867 and that is updated at 6.7900.该课程强调了从概率建模和推理的角度研究机器的方法的深刻理解,适合那些想要建立理论与技能之间稳定联系的人。 Tsinghua电子部门的课程还建立了基本的理论课程,例如“机器研究”和“统计推论理论和方法”。 LLM的最新内容主要出现在特殊的选修课程中CH作为斯坦福大学CS25:Transformers United,专注于LLM的研究课程和变形金刚建筑。有关详细信息,请参阅“ Openai和Google等开放一线大型模型科学家”。 Stanford CS25将于春季推出! 》。可以看出,教育社区通常认为基本教学有助于学生的长期发展。 Chit在编写讲义时提到萨顿的“痛苦课”,强调普遍的可扩展技术(例如NG SGD作为主要的)比特定的体系结构更为重要。他故意删除复杂的系统(例如LLM),并专注于历史上的成熟幻想和数学直觉,认为“一个学期不足以渗透所有学科”,因此他只能将坚实的基础放在首位。此外,Cho在他的博客中指出,在2010年至2015年之间,深入研究尚不流行,许多神经网络只是许多ML课程。现在,通过强调经典方法,阅读ClassiC论文可以让学生了解知识的资源和发展,并培养批判性思维能力。通常,教学的主要重点使学生能够掌握优化算法背面的数学原则和方法,而不是“盲目应用”最新模型。理论与培训相比,但我们无法避免的一个问题是:大学培训机制(尤其是研究生/医生教育)强调了科学研究的基础,原理和技能,而实际的工作环境通常需要快速响应,工程实施和相关的技能,尤其是在行业中。在某些情况下,对“应理解的深度原则”的盲目压力似乎很漂亮,“为什么不吃切碎的肉”。 “如何在不引起注意Q/K/V向量的情况下修复模型?”事实可能是:“我只想知道一种好的调整方法,并与美洲驼一起编写客户服务机器人。”许多Muniversity正在积极探索解决方案。为了建立科学研究和工程能力之间的连通性,许多学校已经开设了“桥接”课程或实践项目。例如,根据CS229等理论课程,斯坦福大学专门建立了CS329S“机器学习系统设计”的实用课程。本课程的重点是如何开发实际部署,稳定和测量的机械研究系统,包括数据处理,具有获取,模型启动和监视。 CMU的博士生应参加10-718课程“机器学习实践”。在本课程中,学生将需要完成学期项目,以生成和部署完整的机器研究系统。清楚地说,P The课程将描述学生将通过研究项目来解决实际情况下的数据问题,并掌握从清理原始数据到最终发布的完整过程技能模型。国内大学也开始关注实践教学。 Tsinghua大学电子系与企业合作,提供了许多实用课程,例如“大数据技术的应用和实践”,“高级机器学习”和“智能制造”等,这些课程介绍了教学过程中的行业和教学技能的实际情况。为什么高校仍然沉迷于“缓慢的工作”?反对当今的后期技术发展,许多大学仍在强调“为坚实的基础和深刻的理解,这不仅仅是“统一”。真正的技术能力不仅在于“学习如何使用工具”或“运行模型的能力”,还在于了解方法背后的原理以及在面对新问题和新技术时团结,判断和创造的能力。在基本经验中,他强调“可靠,及时更新basic knowledge is the key to being a highly productive engineer in the study of the article." Cnn up to transformer up to llm and mUsLimodal system, each step can interfere with existing engineering paradigm. In order to adapt to these changes, we cannot pursue hot topics, but we need to deeply understand the underlying theories such as optimization, generalization, and study of representation. Simply by understanding "why the design is like this" and "what are the assumptions背后“我们可以避免面对新技术时避免混乱。此外,深层的基础是科学研究和创新技术的起点。科学研究不仅是关于组织参数或制作论文,而且还涉及增加问题,建立假设和设计新方法,这是与良好的数学工具相距甚远的培训。也是思考和批判性思维能力的摘要。深度学习和图灵奖得主的获胜者杰弗里·欣顿(Geoffrey Hinton)在接受麻省理工学院技术评论的采访中被教授,这是对重大算法的长期持久性和深入研究,这些算法在深入研究中已经取得了成功。 “我们花了数十年的时间来抛光神经网络的基本原理,直到2010年我们才真正爆发了应用程序。对基础知识的积累和理解是AI领域每个主要发展的基础。”当然,这种教育道路并不忽略这种做法,而是强调真正的实践权力应该基于理解。您不应该知道如何使用工具,但是您还应该了解来和出口,适当的界限和改进的方向。因此,“找到工作”和“基础”不是许多选择中的任何一种,而是在时间大小的情况下进行权衡。在短期,工具技能可以导致直接匹配的工作;但是从长远来看,基本功能是转化为技术周期并继续增长的“护城河”。今天的课程讲义让我们看一下这100页的PDF课程讲义,该课程提供了对机器研究的全面介绍,该课程涵盖了基本概念和现代技术,感兴趣的读者可以阅读原始文本。每一章的结构和内容摘要如下:第1章:能量的人力资源是对能源运行的概念作为一项机器研究的概念。说明如何固定机器研究中的不同范式(管理研究,不支持研究,分类,集群等),以最大程度地减少能量功能。讨论潜在变量和正则化在确定和研究能量功能方面的作用。第2章:基本机器研究分类思想分类的主要分类算法,包括NG感知,边际损失,软磁性和横向渗透损失。解释分类器培训中的反向传播,重点是线性和非线性能量功能。讨论了研究率的随机梯度下降(SGD)和自适应方法。选择概括和模型是Skillgkot,包括偏见变化权衡和调整超参数调整。第3章:神经网络的主要构建块探索了神经网络体系结构上常用的构件。讨论了归一化方法(分批归一化,层归一化)。引入了卷积的块,圆形块和注意机制。引入了衰减和不变性的概念,例如神经网络上的置换。第4章:研究可能性和非监视研究的机器解释了如何从可能性中解释能量的功能。涵盖了差异不同的识别和高斯混合模型。连续的VA讨论了可误的模型和差异自动编码器(VAE)。引入了抽样及其差异的重要性。 Arkata 5:Waladired的生成模型探索了未指定的生成模型,重点是强制Boltzmann机器(RBMS)和专家产品(POE)。讨论Markov链蒙特卡洛(MCMC)方法,以从RBMS进行抽样。引入基于能源网络的基于网络的对抗网络(EBGANS)。涵盖自回归模型。第6章:其他主题提供了机器研究中许多高级主题的一般性决定。已经讨论了有关加强和多步加固研究的分步研究。探索了集成方法(包装包装的方法,提升方法)和贝叶斯机器研究。元学习简介。探索混合密度网络并引起关系。最后,让我们看一下Cho提到的经典论文,其中一部分是 - Xcerpt。 “简单统计梯度 - 遵循Algori连接主义者强化学习的THM“ - 朗德·J·威廉姆斯的论文地址:https://link.springer.com/article/10.1007/bf00992696本文提出了一种基于刺激方法的增强算法,一种基于刺激方法的方法,一种用于培训连接模型(例如神经网络)的较重要的方法(例如,现代的基础)。 Backprop” - Yann Lecun,Leon Botsou,Genevieve B. Orr,Klaus-RobertMüller(关注第4节)论文:https://link.springer.com/chapter/10.1007/978-978-3-3-642-642-642-35289-8_3逐步培训4次培训4个实用方法。最小化不同的差异-irs” -Geoffrey Hinton纸张地址:https://www.cs.toronto.edu/~hinton/~hinton/Absps/nccd.pdf建议培训有多样化的差异-cd)算法,以迫使Boltzmann Machine(rbm)neverction of Bots Boltzmann Machine(rbm)的基础,工作(DBN)。 - 贝叶斯方法结合了神经网络和概率建模,这成为发展模型领域的里程碑。少数算法。 MAML在研究几次射击领域是开创性的。有关更多详细信息,请参阅原始讲座和教学大纲笔记。